-

通义万相Wan2.1- 阿里推出的开源视频生成大模型

通义万相Wan2.1是阿里巴巴推出的开源视频生成大模型,专注于从文本生成高质量图像和视频。Wan2.1 在处理复杂运动、还原真实物理规律、提升影视质感以及优化指令遵循方面具有显著的优势,无论是创作者、开发者还是企业用户,都可以根据自己的需求选择合适的模型和功能,轻松实现高质量的视频生成。 -

-

CogView4 – 智谱推出的开源文生图模型,支持汉字生成

CogView4是北京智谱华章推出的开源文生图模型,支持中英双语输入,擅长生成含汉字图像。它在DPG-Bench测试中排名第一,性能卓越。具备任意分辨率生成和长提示词输入能力,技术领先,遵循Apache 2.0协议,适用于广告、短视频等创意领域。 -

VideoWorld:豆包等推出的开源视频生成模型,从无标签视频中学习知识

VideoWorld是豆包大模型团队联合北京交通大学、中国科学技术大学共同开发的视频生成实验模型,通过无标注的视频数据训练,探索AI如何从视觉输入中学习复杂任务。 -

-

360智脑

360智脑是一个由 360 公司开发的 AI 平台,旨在探索全新的人机协作模式,激活用户的创造力和想象力。它提供了一系列的 AI 工具和服务,包括 API 开放平台、360鸿图、360AI搜索、360AI浏览器、360智脑桌面版和企业数字员工等。 -

GO-1:智元推出的首个通用具身基座模型

GO-1是什么? GO-1是智元机器人发布的通用具身基座大模型,采用ViLLA架构,结合视觉、语言、隐式动作和执行能力。它通过学习人类视频和少量样本泛化新任务,支持多机器人形态并持续进化。GO-1代表了具身智能向通用化、智能化发展的新阶段,预示着机器人将具备更广泛的应用潜力。 GO-1的主要特点 ViLLA架构:GO-1采用Vision-Language-Latent-Action (ViLLA)… -

Seed1.5-VL:字节跳动推出的视觉-语言多模态基础模型

Seed1.5-VL 是字节跳动推出的视觉-语言多模态基础模型,结合图像编码器与200亿激活参数的大语言模型,具备出色的图像、视频理解与推理能力。在60项基准测试中获得38项SOTA,广泛应用于视频问答、图表理解、GUI智能体等任务,表现稳定、推理强大。 -

-

QwQ-32B:阿里云开源的最新AI推理模型,更小尺寸,消费级显卡即可部署

QwQ-32B 是阿里云开源的320亿参数推理模型,具备强大的数学、代码和通用推理能力,性能比肩全球顶尖开源模型。它支持消费级显卡部署,降低硬件门槛,同时集成智能体能力,可灵活调整推理过程。采用Apache 2.0协议开源,用户可免费下载、商用和定制化开发,推动AI技术的广泛应用。 -

昆仑大模型:中国石油等联合发布的能源行业大模型

昆仑大模型是由中国石油、中国移动、华为和科大讯飞联合打造的能源行业大模型。昆仑大模型具备330亿参数,并已通过国家生成式人工智能服务备案,是中国能源化工行业首个通过备案的大模型。其主要目标是推动能源行业的智能化发展,通过创新的四层架构支持油气新能源、炼化新材料等领域的大规模数据建模。 -

ACE-Step:阶跃星辰和ACE Studio联合发布的开源音乐基础模型

ACE-Step 是由阶跃星辰与 ACE Studio 联合开源的音乐大模型,旨在为音乐爱好者提供高效、灵活且高质量的音乐创作工具。该模型参数量为 3.5B,具备多语言支持、快速生成、强可控性及易于拓展等特点,支持多种音乐创作场景,如音频编辑、人声合成、伴奏生成等。 -

天工SkyMusic-昆仑万维推出的AI音乐生成大模型

「天工SkyMusic」是昆仑万维推出的AI音乐生成大模型,基于昆仑万维「天工3.0」超级大模型打造,是目前国内唯一公开可用的AI音乐生成大模型。具备高质量音乐制作、逼真人声合成、精准歌词控制、多元风格适应及复杂歌唱技巧学习等五大特点。该模型基于先进的Transformer技术,能够根据用户输入生成具有丰富情感表达的音乐作品,旨在推动音乐创作的创新和个性化发展。 -

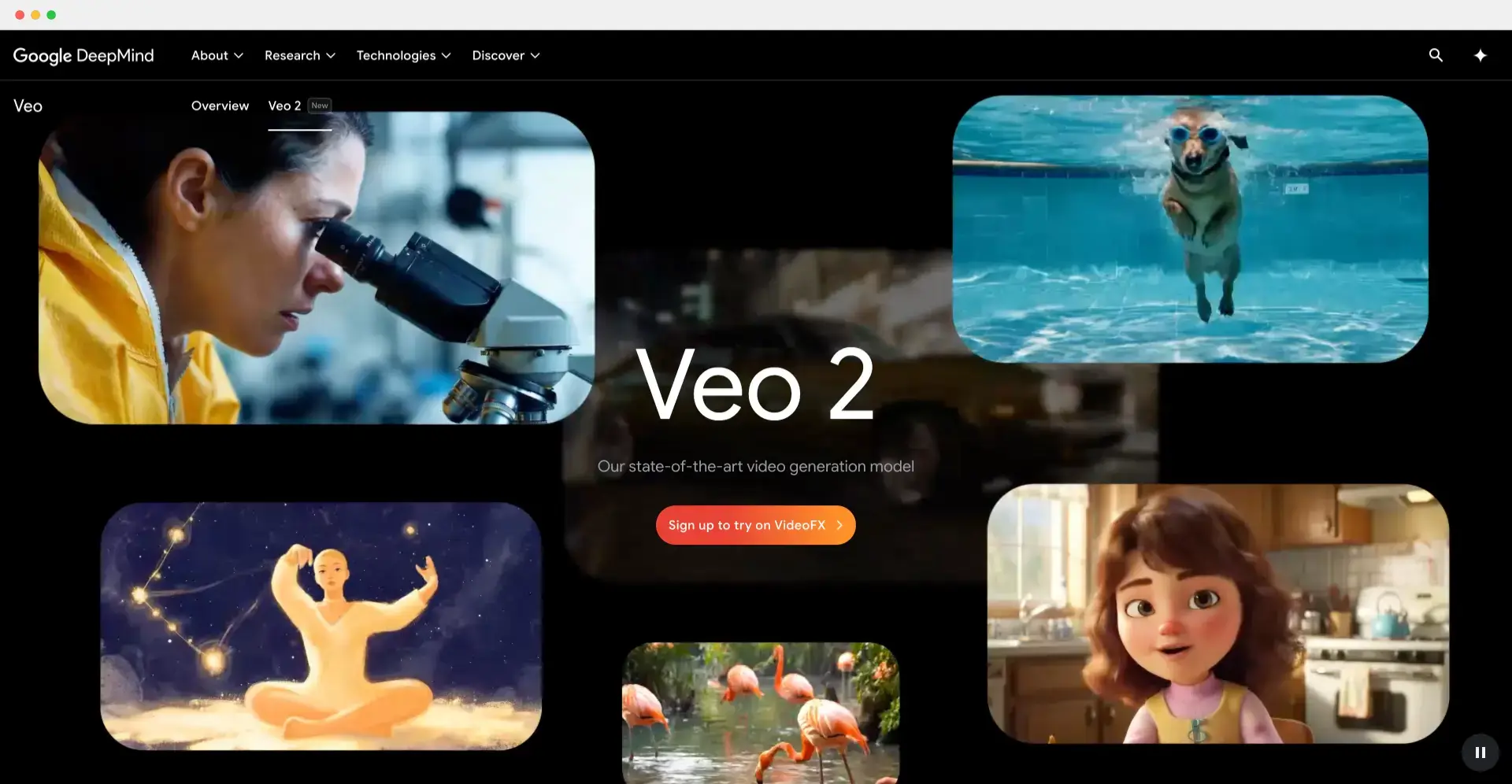

Veo 2:谷歌推出的最新AI视频生成模型,支持生成4k高清视频

Veo 2 是由 Google DeepMind 推出的最新视频生成模型,通过用户的文本提示生成高质量的视频片段,支持分辨率高达4K。Veo 2 的核心技术结合了 AI 对视觉内容的深度理解,能够生成符合指定风格和内容的视频,广泛应用于创意设计和内容创作领域。 -

-

文心大模型X1:百度推出的新一代深度思考模型

文心大模型X1是百度发布的新一代深度思考模型,具备强大的理解、规划、反思和进化能力,支持多模态输入输出以及多种工具调用。它在中文知识问答、文学创作、复杂计算等方面表现出色,性能对标DeepSeek-R1,但API调用价格仅为一半。 -

华知大模型-同方知网携手华为推出的中华知识大模型

华知大模型是同方知网携手华为共同打造内容权威可信、全栈自主可控的专注于知识服务与科研行业的中华知识大模型,旨在覆盖政企文教等多个行业场景,并提供30多项通用能力体系。 -

Llama 3.2:Meta最新推出的开源模型,包括视觉大语言模型和设备端纯文本模型

Llama 3.1是Meta最新推出的开源大语言模型,包括90B和11B两种参数规格的视觉大语言模型,还有能在设备端本地运行的1B和3B轻量级纯文本模型,包括预训练和指令调整版。1B和3B模型支持128K tokens上下文,适配高通和联发科硬件,并针对Arm处理器做了优化。 -

Codestral 25.01:Mistral AI最新推出的AI编程模型,编程速度提高2倍

Codestral 25.01是由Mistral AI推出的一款先进的AI编程模型,旨在显著提升软件开发的效率和质量。作为今年早些时候发布的Codestral的升级版本,Codestral 25.01在架构和分词器上进行了优化,生成和补全代码的速度提升了约2倍。它支持超过80种编程语言,特别适用于低延迟、高频率的使用场景,如代码填充(FIM)、代码修正和测试生成。 -

-

dots.llm1:小红书开源的 MoE 架构大语言模型

dots.llm1是小红书开源的 MoE 架构大语言模型,拥有 1420 亿参数,推理仅激活 140 亿,兼顾性能与效率。模型基于 11.2 万亿非合成高质量数据训练,支持中英文,具备 32K 长上下文处理能力,并开放中间训练 checkpoint,适合问答、内容生成、语义理解等多种应用场景。 -

GLM-Realtime:智谱最新推出的端到端AI模型,支持2分钟记忆和清唱功能

GLM-Realtime是由智谱推出的低延迟端到端多模态模型,具备视频理解、语音交互、内容记忆、清唱功能和 Function Call 功能。它适用于多种实时交互场景,通过 Function Call 功能可以拓展到更广泛的商业应用。开发者可以免费调用该模型,体验其强大的实时交互能力。 -

TransGPT:国内首个综合交通大模型

TransGPT是国内首款开源交通大模型,主要致力于在真实交通行业中发挥实际价值。它能够实现交通情况预测、智能咨询助手、公共交通服务、交通规划设计、交通安全教育、协助管理、交通事故报告和分析、自动驾驶辅助系统等功能。 -

Qwen2-Audio:阿里推出的开源音频语言大模型

Qwen2-Audio是由阿里通义团队推出的大型音频语言模型系列,它能够接受音频信号输入,进行音频分析或直接文本响应,支持语音聊天和音频分析两种交互模式,并且提供了预训练模型Qwen2-Audio-7B和聊天模型Qwen2-Audio-7B-Instruct的版本。